Nell'ambito dell'Architecture Day, Intel ha parlato dei prossimi processori per server Sapphire Rapids, confermando la maggior parte delle informazioni pubblicate in precedenza e integrandole con alcuni dettagli. Intel sta posizionando i nuovi prodotti come soluzione per una gamma più ampia di attività e carichi di lavoro rispetto a prima, inclusi gli ormai popolari microservizi, containerizzazione e virtualizzazione. L'azienda promette che le CPU saranno bilanciate in termini di calcolo, memoria e I/O.

I nuovi processori hanno finalmente ottenuto un chiplet, o tile nella terminologia Intel, layout: il SoC include quattro tile "core" basati sulla tecnologia di processo Intel 7 (10 nm Enhanced SuperFIN). Ogni tessera è collegata al suo vicino tramite EMIB. I loro agenti di sistema, inclusi fino a 100+ MB di cache L3 totale, formano una rete mesh veloce con una latenza di circa 4-8 ns in una direzione. Dall'esterno, il processore "sembrerà" essere monolitico.

Ogni core o thread avrà libero accesso a tutte le risorse dei riquadri adiacenti, inclusi cache, memoria, acceleratori e blocchi IO. Potenzialmente, questo approccio è più redditizio dal punto di vista dello scambio dati interno rispetto al caso di AMD con un'unità IO comune per tutti i chiplet, che in futuro gli EPYC saranno già 12. Ma come sarà effettivamente, lo sapremo solo l'anno prossimo: l'uscita di Sapphire Rapids è prevista per il primo trimestre del 2022, con la produzione di massa nel secondo trimestre.

Sapphire Rapids si basa sulla microarchitettura Golden Cove, che è più ampia, profonda e intelligente. Verrà utilizzato anche nei core Alder Lake ad alte prestazioni, ma ci sono alcune differenze nel caso dei processori per server. Ad esempio, la cache L2 è aumentata a 2 MB per core o il nuovo set di istruzioni AMX (Advanced Matrix Extension). Quest'ultimo espande la funzionalità AI della CPU e consente operazioni MAC su matrici, tipiche di questo tipo di carico di lavoro.

Per AMX, ci sono otto registri 2D dedicati con un volume di 1 KB ciascuno (sedici righe da 64 byte). Un'unità hardware separata esegue operazioni MAC su tre registri e ciò può essere eseguito in parallelo con l'esecuzione di altre istruzioni nel resto del kernel. L'impostazione dei parametri e del contenuto dei registri, così come lo spostamento dei dati, è gestito dal sistema operativo. Finora, nei processori è presentato solo il blocco MAC, ma in futuro potrebbero apparire blocchi per altre operazioni più complesse.

Al suo apice, le prestazioni AMX su INT8 sono 2048 operazioni per ciclo per core, otto volte più veloci delle tradizionali istruzioni AVX-512 (su due porte FMA). Sul BF16, le prestazioni AMX sono due volte più basse, ma si tratta comunque di un aumento significativo rispetto alla generazione precedente Xeon: Intel sta ancora cercando di creare core universali che possano far fronte non solo all'inferenza, ma anche all'addestramento dei modelli AI. Tuttavia, la società afferma che le capacità della CPU di AMX integreranno le GPU piuttosto che competere direttamente con esse.

È Sapphire Rapids che dovrebbe finalmente rendere più diffuso il BF16, dal momento che Cooper Lake, dove il supporto per questo formato dati è apparso per la prima volta nelle CPU Intel, ha una nicchia di applicazione piuttosto ristretta. Altri aggiornamenti architetturali includono il supporto FP16 per AVX-512, istruzioni per l'aggiunta rapida (FADD) e una gestione dei dati più efficiente nella gerarchia della cache (CLDEMOTE), una serie di nuove istruzioni e interruzioni per lavorare con la memoria e TLB per macchine virtuali (VM) , telemetria avanzata con conteggio dei microsecondi e così via.

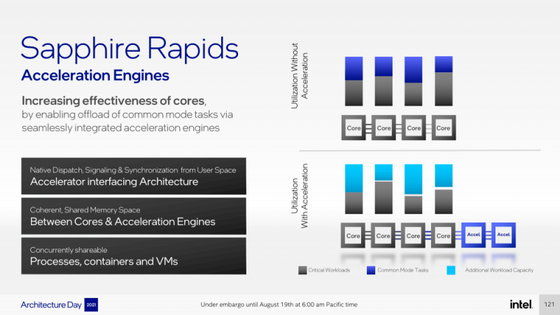

Gli ultimi punti, in generale, sono necessari per una gestione delle risorse e una QoS più efficienti e intelligenti per processi, contenitori e VM: tutti in qualche modo riducono i costi generali. Acceleratori dedicati velocizzano ancora di più il lavoro. Finora ne sono stati citati solo due. Il primo, DSA (Data Streaming Accelerator), velocizza lo spostamento e il trasferimento dei dati sia all'interno di un singolo host che tra più host. Ciò è utile quando si ha a che fare con memoria, archiviazione, traffico di rete e virtualizzazione.

Il secondo acceleratore citato è il QAT (Quick Assist Engine), che può essere utilizzato per operazioni o contemporaneamente una catena di operazioni (de-)compressione (fino a 160 Gbps in entrambe le direzioni contemporaneamente), hashing e crittografia (fino a 400 Gbps) negli algoritmi più diffusi: AES GCM / XTS, ChaChaPoly, DH, ECC, ecc. Ora il blocco QAT è diventato parte del processore stesso, mentre prima era disponibile come parte di alcuni chipset o come scheda di espansione separata. Ciò ha permesso di ridurre i ritardi e aumentare le prestazioni dei blocchi.

Inoltre, QAT può essere utilizzato, ad esempio, per la virtualizzazione o l'architettura di interfaccia con acceleratore Intel (AiA). AiA è un altro nuovo set di istruzioni progettato per funzionare in modo più efficiente con acceleratori integrati e discreti. AiA aiuta con il controllo, la tempistica e la segnalazione, che di nuovo ridurranno parte del sovraccarico quando si interagisce con gli acceleratori dello spazio utente.

Il sottosistema di memoria include quattro controller DDR5 a doppio canale, uno per ogni tile. Presumibilmente, ci saranno quattro domini NUMA disponibili. A parte il menzionato supporto per la prossima generazione di Intel Optane PMem 300 (Crow Pass), non sono stati forniti ulteriori dettagli. Ma è stata ufficialmente confermata la presenza di modelli con a bordo HBM, anche un modulo per piastrella. La HBM può essere utilizzata come cache DRAM o indipendentemente. In alcuni casi, sarà possibile fare a meno della DRAM.

Non c'è nulla da aggiungere su PCIe 5.0 e CXL 1.1 (CXL.io, CXL.cache, CXL.memory), anche se in un altro rapporto Intel ha chiarito che si basa su CXL come interconnessione non solo all'interno di un nodo, ma anche in il futuro a livello di rack. Per combinare la CPU (seamless fino a 8S), verrà comunque utilizzato il bus UPI, ma già di seconda generazione (16 GT/s per linea) - 24 linee per tile.

In particolare per Sapphire Rapids, Intel non ha ancora fornito dati precisi sulla crescita di IPC rispetto a Ice Lake-SP, limitandosi solo a cifre individuali in alcune attività e aree. Non sono stati inoltre specificati numerosi altri parametri importanti. Tuttavia, AMD EPYC Genova, secondo le ultime indiscrezioni, è notevolmente avanti rispetto a Sapphire Rapids anche nelle caratteristiche puramente quantitative.

2021-08-19 15:22:46

Autore: Vitalii Babkin