Durante l'evento GTC 2022, NVIDIA ha annunciato la nuova architettura grafica Hopper e i primi prodotti basati su di essa: gli acceleratori informatici H100. I loro chip sono circa 80 miliardi di transistor e sono prodotti utilizzando la tecnologia di processo TSMC N4 (migliorata 5 nm).

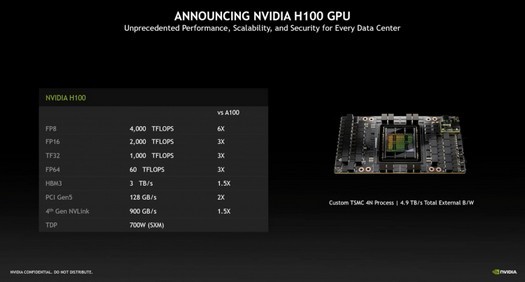

La società sostiene un aumento di tre volte delle prestazioni nelle operazioni FP64, TF32, FP16 e un aumento di sei volte delle prestazioni nelle operazioni FP8 per l'H100 rispetto a NVIDIA A100.

L'H100 include anche 80 GB di memoria HBM3 con una larghezza di banda di 3 TB/s, che è 1,5 volte più dell'attuale acceleratore di intelligenza artificiale NVIDIA A100.

Le caratteristiche principali degli acceleratori NVIDIA H100 sono il nuovo Transformer Engine, il supporto per speciali istruzioni DPX per la programmazione dinamica, la seconda generazione della tecnologia di virtualizzazione GPU Multi-Instance, il supporto per la 4a generazione del bus NVLink con una velocità di trasferimento dati di 900 GB/s, e il nuovo NVSwitch che permette di collegare direttamente fino a 256 acceleratori.

Gli acceleratori NVIDIA H100 saranno disponibili sia nel formato della scheda di espansione PCI Express 5.0 con un TDP di 350 W, sia nel fattore di forma SXM5 con un TDP dichiarato di 700 W, che è 300 W in più rispetto all'A100. Allo stesso tempo, la versione PCIe riceverà un chip meno potente con 14.592 core CUDA. Il modello in formato SXM5 sarà costruito su un chip con 16.896 core.

L'azienda afferma che i primi prodotti basati su acceleratori H100 saranno la quarta generazione di sistemi DGX - DGX H100, che sarà in grado di fornire fino a 32 PFlops di prestazioni di calcolo AI nelle operazioni FP8. I partner offriranno piattaforme HGX per 4 o 8 acceleratori. La presenza della quarta generazione del bus NVLink Switch consentirà di collegare in rete fino a 32 sistemi DGX H100, formando sulla base la prossima generazione di supercomputer NVIDIA DGX SuperPOD. La stessa NVIDIA sta attualmente lavorando alla creazione del supercomputer EOS, che sarà composto da 576 sistemi DGX H100 e riceverà prestazioni FP64 a livello di 275 Pflops e FP16 - 9 Eflops.

I principali fornitori di servizi cloud come Alibaba Cloud, Amazon Web Services, Baidu AI Cloud, Google Cloud, Microsoft Azure, Oracle Cloud e Tencent Cloud hanno già mostrato interesse per la nuova architettura di Hopper e prevedono di utilizzare soluzioni basate sugli acceleratori NVIDIA H100 nei loro ecosistemi .

2022-03-22 18:15:04

Autore: Vitalii Babkin