Während der Veranstaltung GTC 2022 kündigte NVIDIA die neue Hopper-Grafikarchitektur und die ersten darauf basierenden Produkte an – die H100-Rechenbeschleuniger. Ihre Chips bestehen aus etwa 80 Milliarden Transistoren und werden mit der TSMC N4-Prozesstechnologie (verbesserte 5 nm) hergestellt.

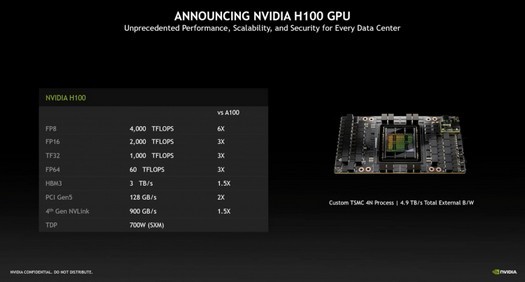

Das Unternehmen behauptet eine dreifache Leistungssteigerung im FP64-, TF32-, FP16-Betrieb und eine sechsfache Leistungssteigerung im FP8-Betrieb für den H100 im Vergleich zum NVIDIA A100.

Der H100 enthält außerdem 80 GB HBM3-Speicher mit einer Bandbreite von 3 TB/s, was 1,5-mal mehr ist als der aktuelle NVIDIA A100 AI-Beschleuniger.

Die Hauptmerkmale der NVIDIA H100-Beschleuniger sind die neue Transformer Engine, Unterstützung für spezielle DPX-Anweisungen für die dynamische Programmierung, die zweite Generation der Multi-Instanz-GPU-Virtualisierungstechnologie, Unterstützung für die 4. Generation des NVLink-Busses mit einer Datenübertragungsrate von 900 GB/s und der neue NVSwitch, mit dem Sie bis zu 256 Beschleuniger direkt verbinden können.

NVIDIA H100-Beschleuniger werden sowohl im PCI Express 5.0-Erweiterungskartenformat mit einer TDP von 350 W als auch im SXM5-Formfaktor mit einer deklarierten TDP von 700 W erhältlich sein, was 300 W mehr als beim A100 ist. Gleichzeitig erhält die PCIe-Version einen schwächeren Chip mit 14.592 CUDA-Kernen. Das Modell im SXM5-Format wird auf einem Chip mit 16.896 Kernen aufbauen.

Das Unternehmen sagt, dass die ersten Produkte, die auf H100-Beschleunigern basieren, die vierte Generation von DGX-Systemen sein werden – DGX H100, die in der Lage sein werden, bis zu 32 PFlops KI-Rechenleistung im FP8-Betrieb bereitzustellen. Partner werden HGX-Plattformen für 4 oder 8 Beschleuniger anbieten. Das Vorhandensein der vierten Generation des NVLink Switch-Busses ermöglicht die Vernetzung von bis zu 32 DGX H100-Systemen und bildet auf ihrer Basis die nächste Generation von NVIDIA DGX SuperPOD-Supercomputern. NVIDIA selbst arbeitet derzeit an der Entwicklung des EOS-Supercomputers, der aus 576 DGX H100-Systemen bestehen und eine FP64-Leistung auf dem Niveau von 275 Pflops und FP16 - 9 Eflops erhalten wird.

Führende Anbieter von Cloud-Diensten wie Alibaba Cloud, Amazon Web Services, Baidu AI Cloud, Google Cloud, Microsoft Azure, Oracle Cloud und Tencent Cloud haben bereits Interesse an der neuen Architektur von Hopper gezeigt und planen, Lösungen auf Basis von NVIDIA H100-Beschleunigern in ihren Ökosystemen einzusetzen .

2022-03-22 18:15:04

Autor: Vitalii Babkin