GTC 2022イベント中に、NVIDIAは新しいホッパーグラフィックスアーキテクチャとそれに基づく最初の製品であるH100コンピューティングアクセラレータを発表しました。それらのチップは約800億個のトランジスタであり、TSMC N4プロセス技術(5 nmの改良)を使用して製造されています。

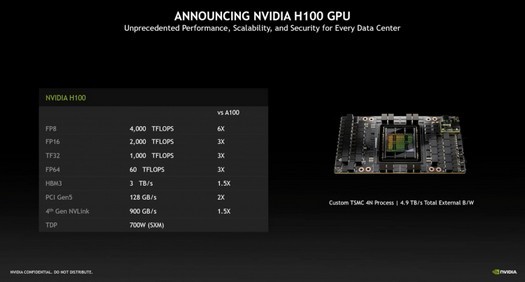

同社は、NVIDIA A100と比較して、H100のFP64、TF32、FP16操作のパフォーマンスが3倍向上し、FP8操作のパフォーマンスが6倍向上したと主張しています。

H100には、帯域幅が3 TB /sの80GBのHBM3メモリも含まれています。これは、現在のNVIDIAA100AIアクセラレータの1.5倍です。

NVIDIA H100アクセラレータの主な機能は、新しいTransformer Engine、動的プログラミング用の特別なDPX命令のサポート、第2世代のマルチインスタンスGPU仮想化テクノロジー、900のデータ転送速度での第4世代のNVLinkバスのサポートです。 GB / s、および最大256個のアクセラレータを直接接続できる新しいNVSwitch。

NVIDIA H100アクセラレータは、TDPが350WのPCI Express 5.0拡張カード形式と、宣言されたTDPがA100より300W多い700WのSXM5フォームファクタの両方で利用できます。同時に、PCIeバージョンは、14,592個のCUDAコアを備えたそれほど強力ではないチップを受け取ります。 SXM5形式のモデルは、16,896コアのチップ上に構築されます。

同社によれば、H100アクセラレータをベースにした最初の製品は、第4世代のDGXシステムであるDGX H100であり、FP8操作で最大32PFlopsのAIコンピューティングパフォーマンスを提供できます。パートナーは、4つまたは8つのアクセラレータ用のHGXプラットフォームを提供します。第4世代のNVLinkスイッチバスの存在により、最大32台のDGX H100システムのネットワークが可能になり、それらに基づいて次世代のNVIDIADGXSuperPODスーパーコンピューターが形成されます。 NVIDIA自体は現在、576 DGX H100システムで構成され、275PflopsおよびFP16-9EflopsのレベルでFP64パフォーマンスを受け取るEOSスーパーコンピューターの作成に取り組んでいます。

Alibaba Cloud、Amazon Web Services、Baidu AI Cloud、Google Cloud、Microsoft Azure、Oracle Cloud、Tencent Cloudなどの主要なクラウドサービスプロバイダーは、Hopperの新しいアーキテクチャにすでに関心を示しており、エコシステムでNVIDIAH100アクセラレータに基づくソリューションを使用する予定です。 。

2022-03-22 18:15:04

著者: Vitalii Babkin