Lors de l'événement GTC 2022, NVIDIA a annoncé la nouvelle architecture graphique Hopper et les premiers produits basés sur celle-ci - les accélérateurs de calcul H100. Leurs puces comptent environ 80 milliards de transistors et sont fabriquées à l'aide de la technologie de procédé TSMC N4 (amélioration de 5 nm).

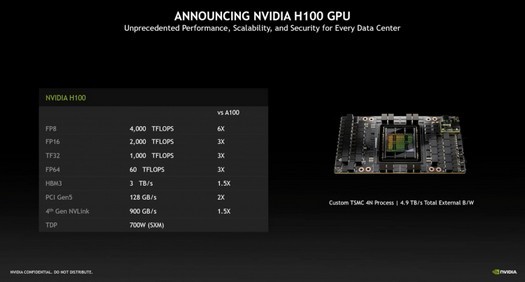

La société revendique une multiplication par trois des performances dans les opérations FP64, TF32, FP16 et une multiplication par six des performances dans les opérations FP8 pour le H100 par rapport au NVIDIA A100.

Le H100 comprend également 80 Go de mémoire HBM3 avec une bande passante de 3 To/s, soit 1,5 fois plus que l'actuel accélérateur NVIDIA A100 AI.

Les principales caractéristiques des accélérateurs NVIDIA H100 sont le nouveau Transformer Engine, la prise en charge d'instructions DPX spéciales pour la programmation dynamique, la deuxième génération de technologie de virtualisation GPU multi-instance, la prise en charge de la 4ème génération du bus NVLink avec un taux de transfert de données de 900 Go / s, et le nouveau NVSwitch qui vous permet de connecter directement jusqu'à 256 accélérateurs.

Les accélérateurs NVIDIA H100 seront disponibles à la fois au format de carte d'extension PCI Express 5.0 avec un TDP de 350W, et au format SXM5 avec un TDP déclaré de 700W, soit 300W de plus que l'A100. Dans le même temps, la version PCIe recevra une puce moins puissante avec 14 592 cœurs CUDA. Le modèle au format SXM5 sera construit sur une puce de 16 896 cœurs.

La société affirme que les premiers produits basés sur les accélérateurs H100 seront la quatrième génération de systèmes DGX - DGX H100, qui sera en mesure de fournir jusqu'à 32 PFlops de performances de calcul AI dans les opérations FP8. Les partenaires offriront des plates-formes HGX pour 4 ou 8 accélérateurs. La présence de la quatrième génération du bus NVLink Switch permettra de mettre en réseau jusqu'à 32 systèmes DGX H100, formant sur leur base la prochaine génération de supercalculateurs NVIDIA DGX SuperPOD. NVIDIA lui-même travaille actuellement sur la création du supercalculateur EOS, qui sera composé de 576 systèmes DGX H100 et recevra des performances FP64 au niveau de 275 Pflops, et FP16 - 9 Eflops.

Les principaux fournisseurs de services cloud tels qu'Alibaba Cloud, Amazon Web Services, Baidu AI Cloud, Google Cloud, Microsoft Azure, Oracle Cloud et Tencent Cloud ont déjà manifesté leur intérêt pour la nouvelle architecture de Hopper et prévoient d'utiliser des solutions basées sur les accélérateurs NVIDIA H100 dans leurs écosystèmes. .

2022-03-22 18:15:04

Auteur: Vitalii Babkin