興味深い資料がNvidiaブログに公開されました。 HPCハイパフォーマンスコンピューティングセグメントを対象とした特殊なアクセラレータのパフォーマンスを比較します。通常、このようなデバイスの技術仕様と生のパフォーマンスの数値のみが利用可能です。この場合、Nvidiaは、実際の状態でのアクセラレータの可能性を、LAMMPS、NAMD、openMM、GROMACS、AMBERなどのデータセンターで一般的なワークロードと比較しようとしました。

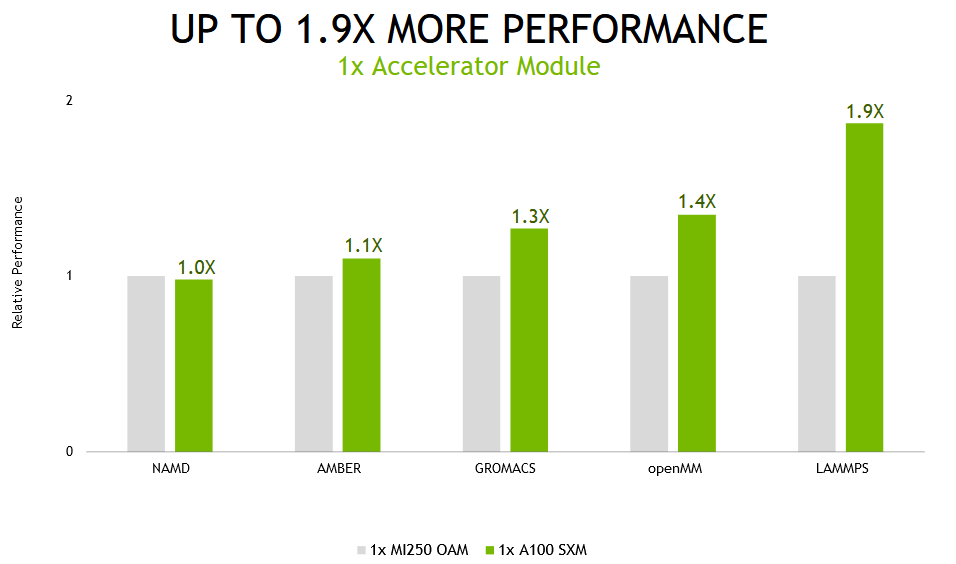

1つおよび4つのアクセラレータを備えた構成でNvidiaA100とAMDInstinctMI250を比較しました。アクセラレータの違いはタスクによって異なり、どこかで10%であり、どこかでNvidiaA100は競合他社の2倍の速さです。以下のグラフは、さまざまな負荷での加速器の効率係数を示しています。

また、Nvidiaのソリューションはエネルギー効率に勝っています。 LAMMPSワークロードの場合、ワットあたりのパフォーマンスの向上は、NvidiaA100を優先して最大2.8倍向上します。

Nvidia A100アクセラレータは、2020年に最初に発表されました。 540億個のトランジスタを備えた大規模なAmpereGPUを使用しています。 A100には、6912個のストリームプロセッサ、432個のテンソルコア、および5120ビットバスを備えた40GBのHBM2メモリが搭載されています。 AMD Instinct MI250アクセラレータの中心には、13312ストリームプロセッサと128GBのHBM2Eメモリを備えたコードネームAldebaranのGPUがあります。 AMDには、多数のコンピューティングユニットを備えたトップモデルのAMD Instinct MI250Xもあります。しかし、古いNvidiaA100アクセラレータの結果は依然として印象的です。同時に、NvidiaはすでにHopperアーキテクチャに基づく新世代のH100アクセラレータを発表しています。

2022-06-04 08:21:08

著者: Vitalii Babkin