La terza generazione di Intel® Xeon® Scalable include due famiglie di processori, nome in codice Cooper Lake-SP e Ice Lake-SP. Ma se il primo è stato creato per la costruzione di sistemi multi-socket ed è focalizzato principalmente su attività aziendali specifiche, allora Ice Lake-SP è focalizzato su piattaforme a due socket di massa e sono soluzioni veramente universali che coprono l'intera gamma di possibili applicazioni - da Edge a HPC.

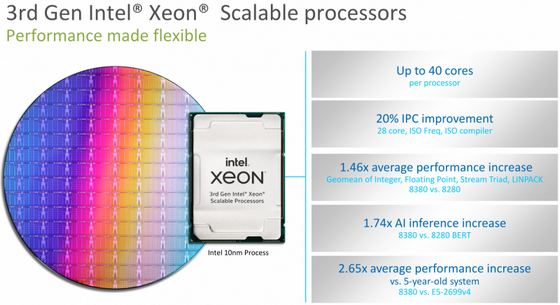

Come già accennato nella nostra recensione, lo Xeon Ice Lake-SP è tecnicamente molto superiore allo Xeon Scalable di seconda generazione (Cascade Lake-SP), sebbene sotto alcuni aspetti siano inferiori al rivale EPYC Milan. Il numero massimo di core in Ice Lake-SP è passato da 28 a 40 e, grazie alla nuova tecnologia di processo, il potenziale di frequenza è aumentato: ad esempio, lo Xeon Gold 6300 a 32 core può funzionare fino a 3,6 GHz per tutti nuclei.

Tutti i processori Ice Lake-SP hanno ricevuto due unità di elaborazione delle istruzioni AVX-512 e il loro set è stato nuovamente ampliato: nuove estensioni sono progettate per ottimizzare il lavoro con i database, la (de)compressione e la crittografia. Supporto mantenuto per le estensioni Intel® DL Boost per le attività AI. Inoltre, lo schema di gestione della potenza e della frequenza è stato riprogettato, in modo che Ice Lake-SP possa affermare di essere il leader in termini di tempo di risposta quando il carico cambia.

I nuovi processori sono dotati di un controller di memoria DDR4-3200 a otto canali che supporta anche i moduli Intel® Optane ™ PMem 200 di seconda generazione. Ciò consente non solo di configurare in modo flessibile il sottosistema di memoria, ma anche di ottenere un record di 6 TB di memoria per socket, attualmente inaccessibile a qualsiasi altra CPU. Infine, i nuovi elementi hanno anche ricevuto il pieno supporto per PCI Express 4.0: ogni Ice Lake-SP ha 64 corsie PCIe 4.0, che nelle tipiche piattaforme a due socket offrono 128 corsie per il collegamento dei più moderni acceleratori, unità, adattatori e controller.

La gamma Intel Xeon Ice Lake-SP è piuttosto ricca. Include modelli di processori ottimizzati per le massime prestazioni per core, versioni per sistemi cloud o elaborazione multimediale, opzioni per applicazioni di rete, nonché modelli progettati per una durata estremamente lunga o originariamente destinati all'uso con raffreddamento a liquido.

Le nuove soluzioni nel campo della protezione dei dati dovrebbero essere segnalate separatamente. Quindi, c'era il supporto per la crittografia DRAM completa e l'ambito di applicazione delle enclave di elaborazione protette SGX (tecnologia Intel® Software Guard Extensions) nei nuovi processori è stato notevolmente ampliato: il volume delle enclave può raggiungere i 512 GB in alcuni modelli. Questo, in combinazione con la tecnologia DL Boost, consente, ad esempio, di lavorare con l'apprendimento federato dei modelli di intelligenza artificiale.

Altrettanto importante, la piattaforma Ice Lake-SP di Intel offre ai clienti soluzioni flessibili, modulari e personalizzabili. Lo Xeon Scalable di terza generazione consente non solo di scegliere il processore più adatto, ma anche di configurare il sottosistema di memoria (con o senza l'utilizzo di Optane), retrofit la piattaforma con SSD e controller di rete Intel, oltre a vari acceleratori basati su Habana, Xe o FPGA.

Questa flessibilità di Ice Lake-SP non è passata inosservata ai principali attori del mercato dell'HPC e dell'hardware server: ad esempio, lo sviluppatore russo di HPC, RSK, sta già utilizzando la nuova piattaforma Intel nelle sue soluzioni di supercomputer RSK Tornado, che ha aumentato la sua prestazioni di quasi il 40% per rack.

La novità è già stata testata da molte organizzazioni scientifiche russe: ad esempio, durante la modellazione di oggetti astrofisici con rilascio di energia estremo al P.I. A.F. Ioffe ha riportato un aumento del 76% della produttività e gli scienziati del JINR hanno annunciato un doppio aumento della velocità di elaborazione dei dati ottenuti dal Large Hadron Collider.

E il supporto per AVX-512 può dare ancora di più: ad esempio, i ricercatori dell'Istituto di matematica e matematica computazionale del ramo siberiano dell'Accademia delle scienze russa, durante la simulazione dei processi di formazione stellare utilizzando il nuovo codice di autovettorizzazione per AVX-512, hanno ottenuto un aumento di 16 volte delle prestazioni rispetto ai kernel classici senza supporto per le estensioni vettoriali a 512 bit!

Inutile dire che quanto è importante la sicurezza delle informazioni quando si sviluppano algoritmi di machine learning progettati per gestire processi critici? Lo sviluppatore russo di sistemi di intelligenza artificiale, oneFactor, ha già annunciato il test di nuovi algoritmi di intelligenza artificiale sulla nuova piattaforma Intel. Supporto per enclave volumetriche SGX ha fornito la sicurezza hardware per l'addestramento del modello, poiché viene eseguito esclusivamente all'interno di tale enclave.

La società afferma che la nuova piattaforma scalabile Intel Xeon ha migliorato il rilevamento delle frodi del 20-30%. Con gli algoritmi Ice Lake-SP e oneFactor, i sistemi bancari saranno maggiormente in grado di resistere a tutti i tipi di frode, dalle frodi telefoniche alla manomissione delle richieste di prestito.

Aggregion, uno sviluppatore di sistemi affidabili decentralizzati che possono essere condivisi da aziende amichevoli, rileva la stessa caratteristica della nuova piattaforma. Qualsiasi partnership implica lo scambio di dati e questi dati sono spesso riservati. Sulle versioni precedenti delle piattaforme Xeon, la fiducia poteva essere garantita solo per le più piccole quantità di dati, il che ovviamente non è in linea con le realtà odierne. Ma le enclavi SGX nelle nuove CPU sono prive di questo svantaggio e sono molto adatte per l'implementazione del software Aggregion.

Un'altra azienda russa, GridGain, specializzata in soluzioni in-memory aziendali, ha sfruttato gli altri vantaggi di Ice Lake-SP: il suo sottosistema di memoria flessibile con supporto per i moduli Optane PMem 200. È noto che i moduli DCPMM stessi non sono veloci come quelli convenzionali DRAM, ma molto più economico. In una serie di compiti, tali sistemi ibridi non sono praticamente inferiori ai sistemi DRAM puri e allo stesso tempo possono fornire un volume di dati significativamente maggiore o saranno più economici a parità di volumi.

Insieme al supporto per Intel® AVX-512, questo ha permesso a GridGain di creare la prima piattaforma di elaborazione in memoria del settore con caratteristiche uniche. Gli Optane PMem 200 sono eccellenti per le attività di analisi delle macchine: hanno raggiunto un aumento di dieci volte rispetto all'archiviazione dati convenzionale su un SSD Intel DC 4510 e, in combinazione con l'ottimizzazione delle soluzioni GridGain per AVX-512, le prestazioni possono essere aumentate con un ordine di grandezza.

Memhive sta lavorando in una direzione simile. Il cuore delle sue soluzioni in-memory è il DBMS PostgreSQL, ottimizzato per supportare i nuovi moduli Intel Optane PMem 200. Secondo i dati presentati, l'uso dei moduli Optane ha permesso di aumentare le prestazioni di 10-15 volte in OLTP e scenari OLAP, per garantire latenza zero eliminando la memorizzazione nella cache tradizionale e ridurre il costo di proprietà del 50%. E, ricorda, i nuovi processori scalabili Xeon supportano estensioni che velocizzano il lavoro con i database, quindi dovremmo aspettarci un guadagno ancora maggiore.

ITV, il creatore del sistema di videosorveglianza intelligente Axxon Next, ha anche testato la nuova piattaforma Intel Xeon Scalable. Le soluzioni Intel sono state utilizzate attivamente da ITV in passato, in particolare, acceleratori basati su Intel® Movidius ™ e toolkit software OpenVINO. La terza generazione di Xeon Scalable, essendo più efficiente dal punto di vista energetico e produttiva, è eccellente per l'implementazione di Axxon Next: secondo i test, la nuova microarchitettura ha permesso di aumentare del 16% la velocità degli algoritmi della rete neurale per il rilevamento di persone e auto.

L'ultima versione di Axxon Next 4.5 supporta la maggior parte delle tecnologie offerte da Intel, sia a livello di raccolta e analisi, sia a livello di presentazione dei dati. In quest'ultimo caso, le risorse del sistema client, incluso Intel Quick Sync Video, vengono utilizzate per decodificare i flussi video. Una delle principali innovazioni della versione 4.5 è una nuova rete neurale in grado di riconoscere in modo rapido e sicuro i modelli nella maggior parte delle situazioni standard senza ulteriore formazione.

La terza generazione di Xeon Scalable può essere definita leader nella flessibilità di configurazione per un'attività specifica

I vantaggi della nuova piattaforma sono stati rilevati anche da Mail.ru Group. Il direttore dello sviluppo dell'infrastruttura di Mail.ru Group ha affermato che la piattaforma Ice Lake-SP con i tipici carichi di lavoro di Mail.ru dimostra prestazioni 1,5 volte superiori rispetto alla generazione precedente Xeon Scalable. E tra i fornitori di cloud nazionali, Selectel è stato il primo a offrire ai clienti server dedicati basati su Ice Lake-SP e in più versioni contemporaneamente.

Naturalmente, giganti come Hewlett Packard Enterprise, Lenovo, Dell Technologies e Cisco, così come altri attori chiave nel mercato dei server, non hanno potuto fare a meno di presentare le loro soluzioni basate sulla nuova piattaforma. Ma neanche gli sviluppatori russi si sono fatti da parte. Pertanto, Trinity ha presentato un server 2U universale a due socket E420R-M7, che consente una configurazione flessibile della memoria e del sottosistema di archiviazione, nonché l'installazione di adattatori veloci da 100 GbE.

Un altro sviluppo, per molti versi unico, è il server OCP a due socket Delta Computers Butterfly, che non solo offre opzioni di configurazione del sistema molto flessibili, ma ha anche un proprio BIOS / UEFI, nonché un firmware BMC proprietario registrato nel Registro unificato di programmi russi.

2021-06-15 16:03:51

Autore: Vitalii Babkin