木曜日のブリーフィングで、Appleは、iOS、macOS、watchOS、iMessageで、ユーザーデバイス上の児童虐待の可能性のある画像を検出する新しいテクノロジーを展開する計画についての以前の噂を確認しました。

この秋にリリースされるiOSとiPadOSの最新バージョンには、ユーザーのプライバシーを維持しながら、児童の性的虐待を描いた資料の配布を制限するのに役立つ新しい暗号化アプリケーションが含まれます。

新機能で最も重要なことは、iCloudにバックアップする前にデバイス上の画像をスキャンすることです。したがって、画像がiCloudにアップロードされる前にスキャンは実行されません。何年もの間、Appleはハッシュシステムを使用して、電子メールで送信された児童虐待の画像を識別してきました。同様の機能は、Gmailやその他のクラウドベースのメールサービスで使用されています。本日発表された機能は、他のユーザーに送信されていない場合でも、iCloudに保存されているカスタム画像に同じスキャンを適用します。

Appleは、禁止されている素材を含まない画像にはアクセスできないと述べた。さらに、システムがアカウントに不適切な素材を含むものとして誤ってフラグを立てるリスクは非常に低いです。エラーを完全に排除するために、アップルのスペシャリストはすべてのシステムレポートを手動でチェックします。ユーザーは、児童虐待のシーンを含む画像のデータベースにアクセスできなくなり、システムによってフラグが付けられた画像を特定できなくなります。

Appleは、数学的に非常に信頼できると判断した3人の独立した暗号技術者にシステムの技術的評価を依頼しました。専門家は、このシステムにより、禁止されている写真やビデオを所有または販売している人々が捕まる可能性が大幅に高まると指摘しています。さらに、システムの精度により、違法な素材を含まない画像にタグを付けることはほぼ不可能です。

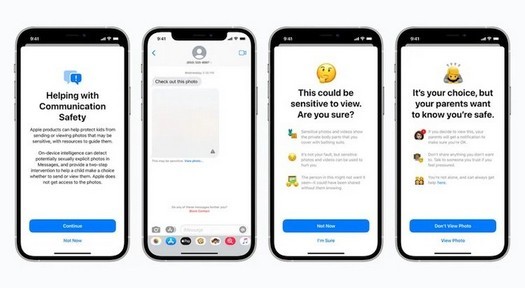

iCloud Photosの新しい対策に加えて、Appleは最年少のiPhone所有者を侵入者から保護するために2つの追加システムを追加しました。メッセージアプリは、添付された画像をスキャンして子アカウントを探し、露骨な可能性のあるコンテンツを検出します。検出されると、コンテンツがぼやけて警告が表示されます。さらに、子供が露骨な画像を送受信した場合、保護者に通知されます。

別のシステムはSiriに関するものです。音声アシスタントは、児童虐待のシーンを含むコンテンツを見つけることが問題になる可能性があることをユーザーに説明し、不健康な興味を排除するのに役立つリソースへのリンクも提供します。

2021-08-06 03:52:54

著者: Vitalii Babkin