Lors d'un briefing jeudi, Apple a confirmé les rumeurs antérieures de plans pour déployer une nouvelle technologie dans iOS, macOS, watchOS et iMessage qui détectera potentiellement les images d'abus d'enfants sur les appareils des utilisateurs.

Les dernières versions d'iOS et d'iPadOS, qui sortiront cet automne, contiendront de nouvelles applications cryptographiques qui permettront de limiter la diffusion de matériel illustrant des abus sexuels sur des enfants, tout en préservant la confidentialité des utilisateurs.

La chose la plus importante à propos de la nouvelle fonctionnalité est qu'elle numérise les images sur l'appareil avant de les sauvegarder sur iCloud. Par conséquent, la numérisation n'a pas lieu avant que l'image ne soit téléchargée sur iCloud. Pendant des années, Apple a utilisé des systèmes de hachage pour identifier les images d'abus d'enfants envoyées par e-mail. Des fonctionnalités similaires sont utilisées par Gmail et d'autres services de messagerie basés sur le cloud. La fonctionnalité annoncée aujourd'hui appliquera la même analyse aux images personnalisées stockées dans iCloud, même si elles ne sont pas envoyées à d'autres utilisateurs.

Apple a déclaré qu'il n'aurait pas accès aux images ne contenant pas de matériel interdit. De plus, le risque que le système signale par erreur un compte comme contenant du matériel inapproprié est extrêmement faible. Pour éliminer complètement les erreurs, les spécialistes Apple vérifieront manuellement tous les rapports système. Les utilisateurs ne pourront pas accéder à la base de données d'images contenant des scènes de maltraitance d'enfants et ne pourront pas déterminer quelles images ont été signalées par le système.

Apple a commandé une évaluation technique du système à trois cryptographes indépendants qui l'ont trouvé mathématiquement extrêmement fiable. Les experts notent que ce système augmentera considérablement la probabilité que les personnes qui possèdent ou vendent des photos et des vidéos interdites soient arrêtées. De plus, la précision du système rend presque impossible le marquage des images qui ne contiennent pas de matériel illégal.

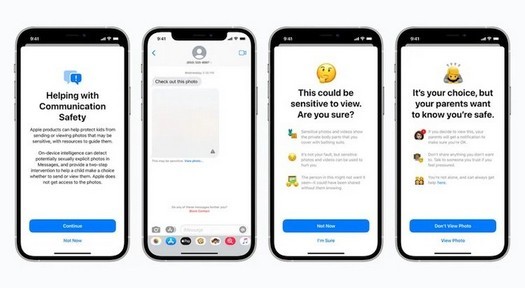

Parallèlement aux nouvelles mesures dans iCloud Photos, Apple a ajouté deux systèmes supplémentaires pour protéger les plus jeunes propriétaires d'iPhone contre les intrus. L'application Messages analyse déjà les images jointes pour les comptes enfants afin de détecter le contenu potentiellement explicite. Une fois détecté, le contenu devient flou et un avertissement apparaît. De plus, les parents seront avertis si un enfant reçoit ou envoie une image explicite.

Un autre système concerne Siri. L'assistant vocal expliquera aux utilisateurs que la recherche de contenu contenant des scènes de maltraitance d'enfants peut être problématique, et fournira également des liens vers des ressources qui aident à éliminer les intérêts malsains.

2021-08-06 03:52:54

Auteur: Vitalii Babkin